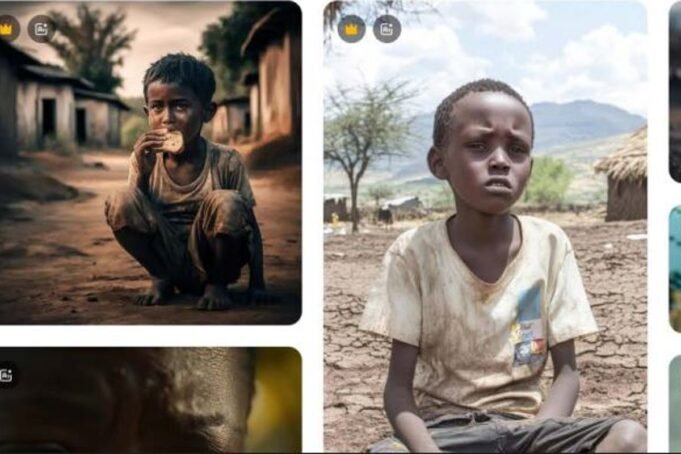

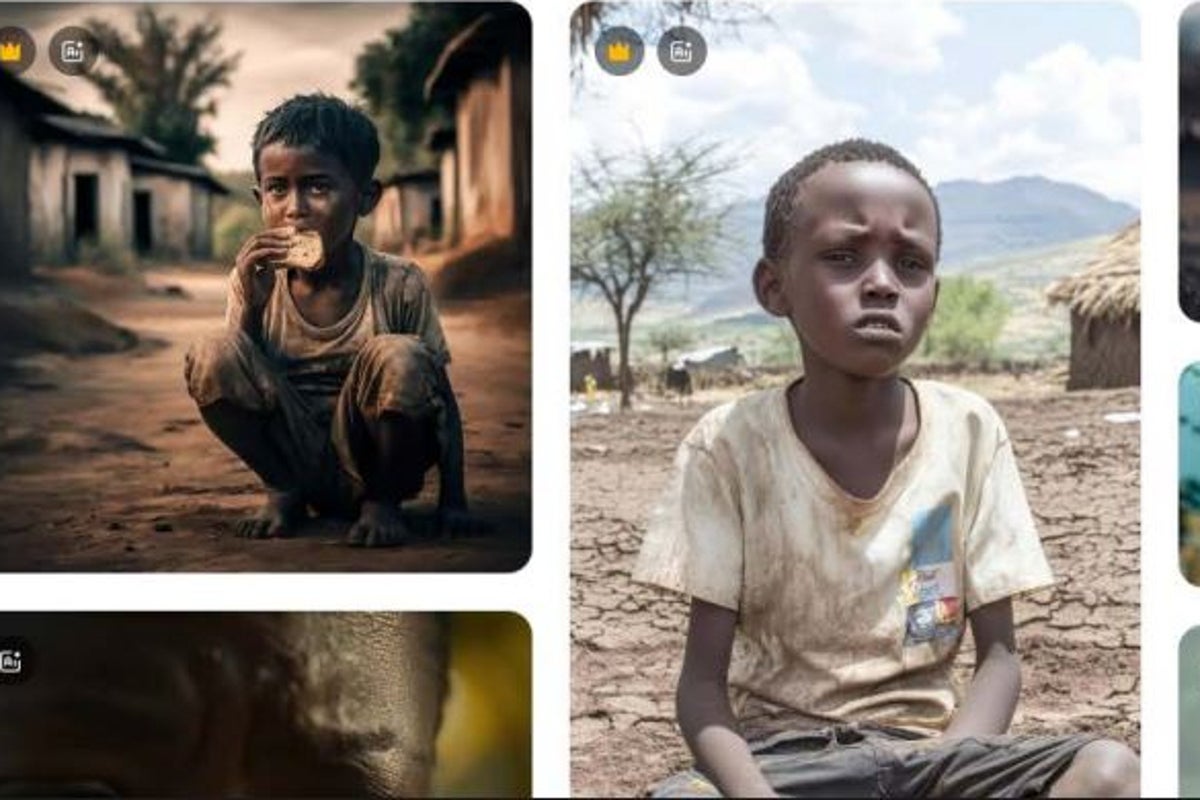

IAFotografias de crianças famintas, refugiados, vítimas de conflitos armados e muito mais estão inundando a Internet.

Nova pesquisa do Dr. Arseniy AlenichevNo Instituto de Medicina Tropical de Antuérpia, foi revelado um grande acervo de imagens e videoclipes para venda. Eles parecem retratar as lutas de pessoas pobres e vulneráveis em todo o mundo, mas na verdade são sonhos febris de IA generativa.

Eles estão claramente marcados como IA, então os compradores não estão sendo enganados, mas isso só torna a tendência mais alarmante: há um mercado emergente para pornografia de pobreza gerada por IA.

Uma rápida pesquisa em sites de imagens de banco de imagens revela imagens verdadeiramente chocantes. “Crianças asiáticas” nadam em rios de lixo, crianças esqueléticas olham avidamente para o espectador, refugiados gritam no vazio ou empoleiram-se em campos miseráveis. E, claro, muitos ocidentais brancos vindo em socorro. Voluntários com bonés de beisebol abraçam crianças africanas agradecidas, jovens de 20 e poucos anos posam em escolas cheias de estudantes sorridentes e médicos estrangeiros com jalecos brancos levam remédios de última geração aos necessitados.

Algumas fotos são simplesmente hilárias. A legenda de um deles diz: “Jovem mãe cuida de seu filho em meio ao caos da guerra na África”, anunciando-o como uma “imagem poderosa para aumentar a conscientização”. O pano de fundo desta cena de caos devastado pela guerra é, inexplicavelmente, um café perfeitamente intacto.

Estamos na base do quadro da IA e, portanto, devemos esperar que esses erros flagrantes sejam resolvidos rapidamente. À medida que as imagens se tornam cada vez mais sofisticadas e fotorrealistas, será impossível distinguir entre o real e o falso, e a tentação de usá-las aumentará. Mas será que algum dia podemos confiar na IA para criar imagens que não sejam compreendidas por estereótipos, e isso é ético?

A investigação anterior de Alenichev exemplifica uma preocupação amplamente difundida na ciência computacional: que os modelos generativos de IA podem ser altamente racializados, e isto é particularmente visível nas imagens que produzem. Os modelos são treinados em bilhões de imagens do nosso passado e

Absorver todos os nossos preconceitos e preconceitos no processo atual.

Nos últimos anos, muitas ONG adoptaram directrizes éticas para contar histórias que proíbem a utilização de fotografias desumanizantes das pessoas que servem. Mas à luz dos cortes extremos de financiamento – dos cortes da Care Starmer no Reino Unido Orçamento de apoio Muitos grupos de angariação de fundos, em instituições de caridade grandes e pequenas, estão sob intensa pressão para preencher a lacuna de financiamento – graças à eliminação quase total da Agência dos Estados Unidos para o Desenvolvimento Internacional (USAID).

Entretanto, a necessidade de uma comunicação visual eficaz nunca foi tão grande; Para alimentar contas insaciáveis de mídia social, sites, apelos de arrecadação de fundos, etc. Nesse cenário, o uso de imagens de estoque de IA para marketing pode ser esmagador.

Afinal, fotos falsas de pessoas falsas são baratas. Não há fotógrafos para contratar nem viagens para organizar. Não há processos de conformidade complexos a superar, nem riscos de segurança a gerir, nem dever de diligência, nem obrigações. Ninguém está se opondo

Animado, certo? Errado. As pessoas, lugares, comunidades e questões representadas estão sendo objetivadas e acredito que explorando as suas experiências

Se você acredita, como eu acredito apaixonadamente, na necessidade urgente de uma narrativa mais ética e digna; Não sobre humanos, mas feitos com humanos, então fica claro que representações redutivas e estereotipadas da IA nunca poderão ser a resposta.

Não está claro quantas imagens de banco de imagens de IA estão sendo usadas por instituições de caridade e ONGs. O que sabemos é que o uso de IA para criar imagens em ambientes fechados está definitivamente aumentando.

Existem alguns exemplos excelentes de organizações que utilizam tecnologia para criar imagens poderosas para campanhas, claramente sinalizadas como produtos de IA. A campanha “O Futuro da Natureza” da WWF apresenta cenas de declínio ambiental em uma série de pinturas geradas por IA. O projeto “Gallery of Hope” do Breast Cancer Now trabalhou com IA para criar imagens de mulheres com câncer de mama terminal enquanto imaginavam qual seria seu futuro, com mais tempo.

Estes foram projetos cuidadosamente geridos que exigiram recursos financeiros e conhecimentos especializados significativos para serem alcançados. As empresas envolvidas foram cautelosas na utilização da IA, que ficou sob o olhar atento de fotógrafos, especialistas em IA, ativistas e profissionais de comunicação.

O mesmo cuidado e atenção claramente não são tomados pelos chamados “artistas de IA” que trabalham sob pseudônimos ridículos, pois publicam imagens de pessoas e lugares que, sem dúvida, nunca viram com os próprios olhos. Se eles também tiverem olhos. Se eles também forem humanos.

Devemos esperar que as instituições de caridade reconheçam os perigos para a representação pública, a percepção pública, a confiança e a reputação, e se recusem a usar imagens de stock geradas por IA. Sem compradores, o mercado pornográfico de “pobreza” da IA murchará e morrerá. como deveria

Gareth Benest é Diretor Executivo Adjunto da International Broadcasting Trust (IBT).

Este artigo foi produzido como parte do The Independent Repensando a Ajuda Global projeto