Na tarde de sexta-feira, quando esta entrevista estava prestes a começar, um alerta de notícias apareceu na tela do meu computador. A administração Trump cortou relações com a Anthropic, uma empresa de IA de São Francisco fundada em 2021 por Dario Amodei e outros ex-pesquisadores da OpenAI que deixaram a empresa por questões de segurança. Secretário de Defesa Pete Hegseth lei de segurança nacional A medida, destinada a combater ameaças estrangeiras à cadeia de abastecimento, visa colocar a empresa na lista negra de fazer negócios com o Pentágono, depois de Amodei se ter recusado a permitir que a tecnologia da Anthropic fosse utilizada para vigilância em massa de cidadãos dos EUA ou para drones armados autónomos que podem seleccionar e matar alvos sem intervenção humana.

Foi uma sequência incrível. A Anthropic agora corre o risco de perder até US$ 200 milhões em contratos e ser impedida de trabalhar com outros empreiteiros de defesa após a postagem do presidente Trump no Truth Social orientando todas as agências federais a “cessar imediatamente o uso da tecnologia Antrópica”. (Anthropic desde então disse que sim) desafiar o Departamento de Defesa em tribunaldisse que a designação de risco da cadeia de suprimentos era legalmente inadequada e “nunca antes havia sido aplicada publicamente a empresas dos EUA”).

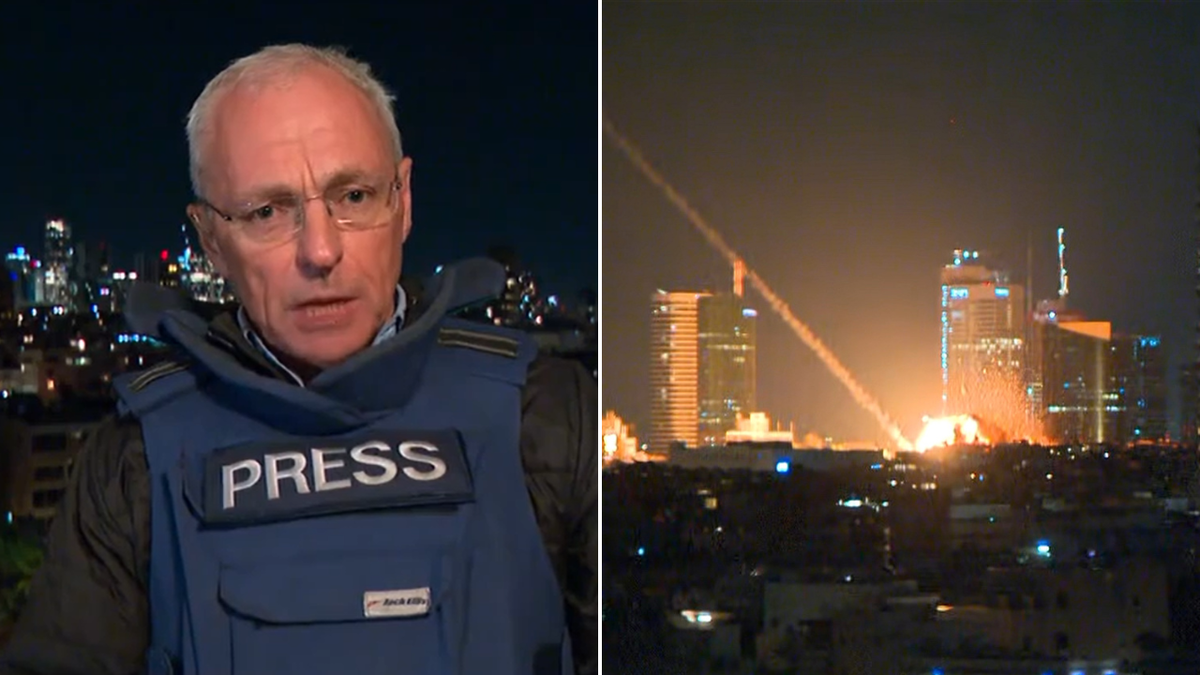

Max Tegmark passou quase uma década alertando que a corrida para construir sistemas de IA cada vez mais poderosos está ultrapassando a capacidade mundial de gerenciá-los. Físico sueco-americano e professor do Instituto de Tecnologia de Massachusetts. Instituto de Pesquisa de Vida Futura Em 2023, ele ajudou a organizar. carta aberta No final, mais de 33 mil pessoas, incluindo Elon Musk, assinaram a petição, apelando a uma moratória sobre o desenvolvimento avançado de IA.

A sua visão da crise da humanidade é implacável. A empresa, tal como os seus rivais, está a plantar as sementes dos seus próprios problemas. O argumento da Tegmark não começa com o Pentágono, mas com uma decisão tomada há anos: uma escolha partilhada por toda a indústria para resistir à regulamentação vinculativa. Empresas como Anthropic, OpenAI e Google DeepMind há muito prometem governar-se de forma responsável. No início desta semana, a Antrópica O princípio central do nosso compromisso de segurança exclusivo — Uma promessa de não lançar sistemas de IA cada vez mais poderosos até termos a certeza de que não causam danos.

Agora que não existem regras, não existem muitas proteções para esses jogadores, disse Tegmark. Abaixo estão os detalhes dessa entrevista, editados para maior duração e clareza. Você pode ouvir a conversa completa no TechCrunch desta semana. Baixar estritamente VC Podcast.

Qual foi o seu primeiro pensamento ao ver essa notícia sobre a Antrópica?

O caminho para o inferno está pavimentado de boas intenções. É muito interessante olhar para trás há 10 anos. Na época, as pessoas estavam entusiasmadas com a forma de desenvolver inteligência artificial para curar o câncer, tornar a América próspera e forte. E aqui estamos nós, com o governo dos EUA furioso com esta empresa por não querer que a sua IA seja usada para vigilância doméstica em massa dos americanos, e por não querer implantar robôs assassinos que possam decidir autonomamente quem será morto sem qualquer intervenção humana.

evento de crise tecnológica

São Francisco, Califórnia

|

13 a 15 de outubro de 2026

A Anthropic aposta toda a sua identidade em ser uma empresa de IA que prioriza a segurança, mas também trabalhou com agências de defesa e inteligência (desde pelo menos 2024). Você acha que isso é contraditório?

Isso é contraditório. Se você puder ter uma visão um pouco cínica disso, então sim. A Anthropic tem sido muito boa em anunciar que tudo se resume a segurança. Mas se você realmente olhar para os fatos e não para as afirmações, verá que Anthropic, OpenAI, Google DeepMind e xAI têm muito a dizer sobre como valorizam a segurança. Não apoiamos regulamentações de segurança vinculativas como outras indústrias. E todas essas quatro empresas quebraram suas próprias promessas. Primeiro foi o Google. Este grande slogan é “Não seja mau”. Então eles largaram. Então eles desistiram de outra longa promessa de basicamente prometer não causar danos à IA. Eles pararam de fazer isso para poder vender IA para vigilância e armas. A OpenAI removeu a palavra segurança de sua declaração de missão. xAI desligou toda a sua equipe de segurança. E agora, no início desta semana, a Anthropic está a voltar atrás no seu mais importante compromisso de segurança: uma promessa de não lançar sistemas poderosos de IA até que esteja confiante de que não causarão danos.

Como é que uma empresa com um compromisso tão notável com a segurança acabou nesta posição?

Todas essas empresas, especialmente OpenAI e Google DeepMind, e até certo ponto também a Anthropic, têm feito lobby incansavelmente contra a regulamentação da IA, dizendo: “Confie em nós, vamos nos regular”. E eles fizeram lobby com sucesso. Atualmente, os sistemas de IA são menos regulamentados nos EUA do que os sanduíches. Se você quiser abrir uma lanchonete e o fiscal de saúde encontrar 15 ratos na cozinha, ele não deixará você vender sanduíches até que você conserte. Mas se você disser: “Não se preocupe, não vou vender sanduíches. Vou vender namoradas com IA para crianças de 11 anos, e elas já foram ligadas a suicídios no passado. E vou expor algo chamado de superagência de inteligência que pode derrubar o governo dos EUA, mas tenho um bom pressentimento sobre o meu”, o inspetor terá que dizer: “Ok, vá em frente, apenas não venda sanduíches”.

Existem regulamentos de segurança alimentar, mas não há regulamentos de IA.

E sinto que todas essas empresas realmente compartilham a responsabilidade por isso. Porque se eles se tivessem unido e aceitado todas as promessas que foram feitas na altura sobre como permanecer seguros e bem, e se tivessem ido ao governo e dito: “Aceite a nossa promessa voluntária e torne-a uma lei americana que vincule até os nossos concorrentes mais desleixados”, isto é o que teria acontecido. Estamos num completo vácuo regulatório. E sabemos o que acontece quando as empresas recebem anistia total. talidomidaAs empresas de tabaco vendem cigarros às crianças e o amianto provoca cancro do pulmão. Portanto, é um tanto irônico que sua própria resistência às leis que ditam o que podem ou não fazer com a IA esteja agora voltando para assombrá-los.

Atualmente, não existe nenhuma lei que proíba o desenvolvimento de IA para matar americanos, pelo que o governo poderia fazer um pedido repentino. Se as próprias empresas tivessem se manifestado antes e dito: “Queremos esta lei”, não estariam nesta situação. Eles realmente deram um tiro no pé.

O contra-argumento empresarial sempre foi a concorrência com a China e, se as empresas americanas não o fizerem, o governo chinês fá-lo-á. Esse argumento é válido?

Vamos analisar isso. O ponto de discussão mais comum entre os lobistas das empresas de IA (que são agora mais bem financiados e em menor número do que os da indústria dos combustíveis fósseis, da indústria farmacêutica e do complexo militar-industrial combinados) é que sempre que alguém propõe algum tipo de regulamentação, eles dizem: “Mas é a China”. Então, vamos dar uma olhada nisso. A China está avançando com a proibição total de namoradas com IA. Além das restrições de idade, também estamos considerando proibições. Toda IA antropomórfica. por que? Não porque queiram agradar à América, mas porque sentem que isto está a arruinar a juventude da China e a enfraquecer a China. É evidente que a juventude americana também está a tornar-se mais fraca.

E quando as pessoas dizem que temos que correr para construir superinteligência para vencer a China, quando na verdade não sabemos como controlar a superinteligência, então o resultado padrão é a humanidade perder o controle da Terra para máquinas alienígenas, o que você acha? O Partido Comunista Chinês realmente gosta de controle. Quem em sã consciência pensaria que Xi Jinping permitiria que empresas chinesas de IA desenvolvessem algo que derrubaria o governo chinês? sem chance. Obviamente, seria muito mau para o governo dos EUA se fosse derrubado num golpe de Estado pela primeira empresa americana a construir uma superagência de inteligência. Esta é uma ameaça à segurança nacional.

Esta é uma estrutura convincente. A superinteligência não é um trunfo, mas uma ameaça à segurança nacional. Você acha que essa opinião está ganhando força em Washington?

Acho que se as pessoas da comunidade de segurança nacional ouvissem a visão de Dario Amodei seria explicada. Ele fez seu famoso discurso e logo… A terra dos gênios dos data centers —Eles podem começar a pensar: espere, Dalio acabou de usar a palavra “país”? Talvez aquela terra de gênios em data centers devesse estar na mesma lista de ameaças que estou monitorando. Isso parece ameaçador para o governo dos EUA. E penso que muito em breve as pessoas da comunidade de segurança nacional dos EUA perceberão que a superinteligência fora de controlo é uma ameaça, não uma ferramenta. Isto é exatamente como na era da Guerra Fria. Houve competição com a União Soviética pela supremacia económica e militar. Nós, americanos, ganhámos essa competição sem entrar numa segunda competição para ver quem conseguia colocar o maior número de crateras nucleares noutras superpotências. As pessoas perceberam que foi apenas um suicídio. Ninguém vence. A mesma lógica se aplica aqui.

O que tudo isto significa para o ritmo mais amplo do desenvolvimento da IA? Quão próximos você acha que estamos do sistema que você está descrevendo?

Há seis anos, quase todos os especialistas em IA que eu conhecia previram que a IA capaz de linguagem e conhecimento de nível humano estaria a décadas de distância, talvez em 2040 ou 2050. Eles estavam todos errados. Porque já temos. Em alguns campos, vimos a IA progredir muito rapidamente do nível do ensino médio para o nível universitário, do nível de doutorado até o nível de professor universitário. No ano passado, a IA conquistou a medalha de ouro na Olimpíada Internacional de Matemática, que é tão difícil quanto o desafio humano. EU escreveu um artigo com Josué Benzio, e Henriquee outros importantes pesquisadores de IA publicaram uma definição rigorosa de AGI há apenas alguns meses. Com isso, o GPT-4 atingiu 27%. O GPT-5 atingiu 57%. Portanto, ainda não chegámos lá, mas o aumento de 27% para 57% sugere imediatamente que poderá não demorar tanto.

Ontem, quando dei uma palestra para estudantes do MIT, disse que mesmo que demore quatro anos, quando você se formar, talvez não consiga encontrar um emprego. Certamente, nunca é cedo para começar a se preparar.

Antrópico está atualmente na lista negra. Estou curioso para ver o que acontece a seguir. Será que os outros gigantes da IA os apoiarão e dirão que não aceitaremos isso também, ou alguém como a xAI levantará a mão e dirá que a Anthropic não queria esse contrato, nós aceitaremos? (Nota do editor: Horas depois da entrevista, OpenAI negociação própria Junto com o Pentágono. )

Sam Altman apareceu ontem à noite e disse que apoia o Anthropic e tem a mesma linha vermelha. Respeito sua coragem em dizer isso. O Google não disse nada no início desta entrevista. Acho que seria muito embaraçoso para a empresa se eles simplesmente permanecessem em silêncio, e acho que muitos de nossos funcionários sentiriam o mesmo. Também não ouvi nada do xAI ainda. Será interessante ver. Basicamente, todo mundo tem um momento em que precisa mostrar seu verdadeiro eu.

Existe uma versão que realmente dá melhores resultados?

Sim, é por isso que estou otimista de uma forma estranha. Há uma alternativa óbvia aqui. Se começarmos a tratar as empresas de IA como outras empresas, se acabarmos com a amnistia corporativa, teremos obviamente de fazer coisas como ensaios clínicos e provar a especialistas independentes que sabemos como controlá-la antes de lançarmos algo tão poderoso. Então teremos uma era de ouro com todos os grandes recursos da IA, sem qualquer ansiedade existencial. Esse não é o caminho que estamos seguindo agora. Mas talvez sim.